O Google não está apenas mudando a interface da busca. Ele está redesenhando a forma como o conhecimento é processado, sintetizado e devolvido ao usuário. Isso fica explícito na patente US20240289407A1, que descreve o funcionamento do AI Mode de maneira muito mais profunda do que qualquer anúncio público.

Michael King (IPullRank) analisou essa patente e mostrou que o sistema não parte mais da palavra digitada, mas da intenção e eu compactuo da mesma opinião =0)

Essa diferença muda completamente a forma como um site é avaliado e como um conteúdo passa a ser selecionado ou ignorado. Esta primeira parte existe para te explicar, com clareza, a base desse novo mecanismo.

A query é apenas o início do raciocínio

Durante anos, otimizamos páginas para frases exatas. O Google funcionava como um mecanismo reativo. Você fazia uma pergunta e ele tentava encontrar documentos compatíveis.

No AI Mode, isso deixa de existir.

O que você digita não é mais a unidade central.

É só o acionamento do processo.

O sistema trata a query como um sinal que precisa ser interpretado dentro de uma situação mais ampla.

Ele não tenta responder a frase, ele tenta entender de onde ela veio, para onde ela pode ir e como ela se encaixa nos padrões de busca de pessoas com comportamento semelhante.

Esse deslocamento obriga o SEO a deixar de focar na correspondência literal e a trabalhar com ecossistemas de intenção, variações naturais e relações semânticas que não dependem da frase original.

O contexto passa a valer mais que o termo digitado

A segunda etapa da patente mostra que o Google recupera dados contextuais antes mesmo de começar a buscar documentos.

Isso inclui:

- buscas anteriores na mesma sessão

- comportamentos recorrentes em semanas ou meses

- tipo de dispositivo

- localização atual e histórica

- padrões de leitura e de rejeição

- associações com produtos do Google usados pela pessoa

Veja esse artigo sobre a Patente do Google que trazz informações sobre o resultado de acordo com seu comportamento.

Essa camada transforma a mesma query em realidades diferentes.

Uma dúvida genérica pode se tornar um pedido de comparação para um usuário e um pedido de explicação para outro.

A mesma pesquisa vai entregar resultados distintos para as pessoas com base no seu comportamento.

Esse comportamento contextual cria um critério novo para SEO e não basta apenas ser relevante, é preciso ser compatível com vários contextos possíveis.

Um conteúdo raso, fixo e estreito não atravessa essa barreira.

A primeira tarefa do modelo é interpretar intenção

Antes de recuperar qualquer documento, o sistema pede para o seu próprio LLM interpretar a pergunta e o contexto.

Essa interpretação gera uma assinatura de intenção.

A patente chama isso de reasoning output.

É o esboço cognitivo que define:

- o que o usuário possivelmente quer

- o que ele está tentando evitar

- qual o grau de confiança que a pergunta exige

- se é uma busca orientada a decisão, comparação ou instrução

- quais ambiguidades precisam ser resolvidas

Esse tipo de processamento significa que o conteúdo não será comparado apenas com a query original, mas com o nível de intenção dominante.

Se você produz textos que só funcionam em uma intenção específica, perde relevância em cenários mais amplos.

A criação de queries sintéticas amplia a competição

Aqui está o ponto mais transformador da patente.

O sistema não tenta responder somente à pergunta original, mas sim, ele tenta entender todo o campo semântico ao redor dela.

Por isso o LLM cria dezenas de queries sintéticas que representam:

- reformulações naturais

- intenções latentes

- perguntas futuras na mesma jornada

- comparações comuns

- temas que costumam aparecer juntos

- padrões de co-busca históricos

É como se o Google perguntasse para si mesmo diversas versões da mesma dúvida, ampliando o espaço de busca.

Esse mecanismo define um novo tipo de SEO.

Agora você não disputa uma query.

Disputa uma galáxia de variações que compõem o fan out da intenção.

Se você só cobre o termo central e não cobre o campo semântico, fica de fora do conjunto de documentos analisados.

O Google monta um corpus sob medida, não um ranking

Depois que o sistema gera o conjunto de queries sintéticas, ele começa a recuperar documentos. Mas esse processo não se parece com o ranking tradicional.

Em vez de buscar as melhores páginas para a query original, o sistema busca os melhores trechos para todo o conjunto de intenções, fazendo com que isso gera um corpus personalizado.

Uma coleção de pedaços que compõem o conhecimento relevante para aquela pessoa, naquele momento.

A página inteira não importa mais, agora o que importa é se um trecho específico da sua página carrega o tipo de informação que o modelo precisa.

Páginas longas, mas desorganizadas, perdem espaço para páginas médias com trechos bem resolvidos ganham prioridade.

A classificação de intenção define o formato da resposta

Depois de escolher os documentos, o sistema classifica a intenção dominante da busca.

Essa classificação não é fixa. Ela é calculada a partir do histórico, das queries sintéticas e do conjunto de documentos.

O sistema decide se a resposta precisa ser:

- explicativa

- comparativa

- analítica

- instrucional

- sintetizada

- estruturada

- narrativa

- objetiva

Esse momento é crucial porque não basta ser correto, é preciso ser útil para o formato que o sistema decidiu adotar.

Se a intenção é comparativa, mas seu conteúdo só explica, você fica de fora.

Se a intenção é decisória, mas o seu conteúdo não orienta, você fica de fora.

Clareza da Patente do AI Mode

A patente deixa claro que o AI Mode não funciona como um buscador clássico.

Ele não tenta encontrar páginas que combinem com uma frase.

Ele tenta entender a intenção, expandir o significado, montar um corpus e produzir uma resposta sintética personalizada.

Para SEO, isso cria um novo cenário.

A disputa não é por posição.

É por utilidade.

É por compatibilidade.

É por amplitude semântica.

É por capacidade de ser reutilizado.

Como tornar seu conteúdo elegível para o AI Mode

A patente deixa claro que o AI Mode funciona como um sistema de raciocínio que constrói significado camada por camada.

Para entrar nesse fluxo, o seu conteúdo precisa operar em um nível totalmente diferente do típico conteúdo SEO.

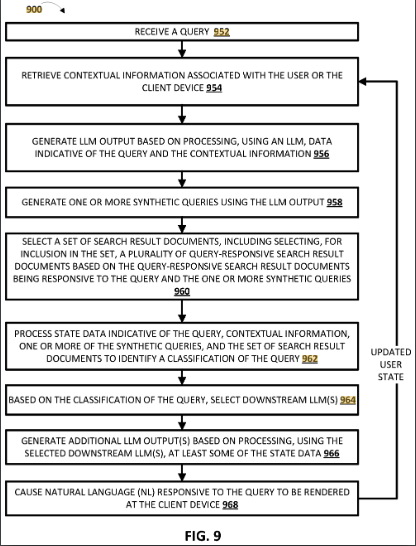

Esta parte existe para te mostrar como construir esse tipo de material e quais componentes o tornam compatível com o mecanismo descrito no FIG. 9 da patente US20240289407A1.

Figura 9 Patente AI Mode

Como o conteúdo precisa responder à interpretação de intenção

O que o modelo precisa enxergar no seu texto

A primeira tarefa do AI Mode é interpretar intenção. Não intenção superficial, mas intenção composta e isso significa que ele tenta entender o que a pessoa quer, o que ela pretende evitar e o que ela pode querer logo em seguida.

Para se tornar elegível nessa etapa, o seu conteúdo precisa oferecer:

- clareza de objeto

- clareza de ação

- clareza de consequência

O sistema não quer apenas saber o que você diz. Ele quer prever o que você vai responder quando a próxima dúvida aparecer dentro daquela jornada.

Na prática

Imagine que alguém busca por como melhorar a drenagem do quintal, um conteúdo genérico responderia como resolver o problema.

O conteúdo elegível ao AI Mode antecipa que essa busca se ramifica em drenagem, tipos de solo, inclinação do terreno, orçamento, opções permanentes e riscos estruturais.

Cada parágrafo precisa representar um ponto completo dessa ramificação.

Esse tipo de antecipação cria a assinatura semântica que o modelo identifica como compatível com queries sintéticas.

Por que a expansão semântica precisa aparecer na própria página

O conteúdo precisa cobrir o espaço antes que o Google o expanda

Quando o LLM cria queries sintéticas, ele procura temas que aparecem naturalmente associados à intenção original. Se o seu conteúdo não cobre essas ramificações, você desaparece dessa etapa.

Por isso, toda página precisa demonstrar amplitude temática. Amplitude não significa quantidade. Significa associação entre entidades, termos e ações coerentes à intenção dominante.

Exemplo prático

Um conteúdo sobre refinanciamento, se escrito apenas explicando o que é refinanciamento, perde relevância. Já um conteúdo que explica:

- como funciona

- como comparar condições

- fatores que alteram taxas

- riscos comuns

- alternativas possíveis

- sinais de que não vale a pena

- dados que o usuário deveria reunir

- entra em múltiplas queries sintéticas.

É esse tipo de estrutura que passa pelo filtro do fan out.

A importância da estrutura em trechos isolados

O AI Mode não lê o documento inteiro

Uma das descobertas mais importantes da patente é que os modelos downstream não consomem o texto inteiro. Eles consomem partes:

- parágrafos curtos

- tabelas

- listas estruturadas

- definições

- comparações

Isso significa que o conteúdo precisa ter trechos autônomos que fazem sentido sem o restante da página. É essa autonomia que permite que o modelo selecione apenas um pedaço do seu texto como fonte.

Na prática

Um parágrafo explicando uma entidade precisa funcionar sozinho.

Por exemplo:

Drenagem profunda é o método usado quando o solo tem baixa absorção e exige remoção de camadas mais densas para permitir a passagem da água. Essa solução é indicada para terrenos argilosos ou superfícies niveladas, onde a infiltração natural é insuficiente.

Esse parágrafo responde a uma dúvida inteira por si só.

Esse é o tipo de trecho que o modelo downstream usa.

Como criar trechos que o modelo consegue reutilizar

A lógica da chunkabilidade

Chunkabilidade é a capacidade de um trecho ser reutilizado sem perda de sentido. O trecho precisa entregar significado completo, ter início e fim claros, não depender de parágrafos anteriores e mostrar uma relação explícita entre entidade e ação.

Componentes essenciais de um chunk funcional

- definição direta

- entidade central

- ação ligada à entidade

- consequência ou implicação

- vocabulário claro

- estrutura curta

Exemplo prático

Considere este chunk sobre intenção comparativa:

Uma intenção comparativa ocorre quando o usuário está avaliando opções dentro de uma mesma categoria e precisa entender diferenças funcionais, custos ou resultados. Esse tipo de intenção exige conteúdos com critérios objetivos, listas de atributos e explicações que ajudam no processo decisório.

Esse bloco é autossuficiente e totalmente reutilizável.

Como produzir Information Gain real

A diferença entre informação inédita e reorganização

A patente deixa evidente que o AI Mode usa síntese, e síntese só funciona quando o corpus oferece insumos diversos. Se o seu conteúdo repete o que todo mundo já diz, você não adiciona nada ao corpus e se não adiciona, não entra no conjunto escolhido.

Information Gain acontece quando você:

- explica uma consequência que ainda não foi explicada

- mostra uma relação que não aparece em conteúdos comuns

- organiza elementos de forma que resolvem algo que ninguém resolveu

- antecipa dúvidas que surgem depois da dúvida principal

- introduz variáveis negligenciadas por conteúdos tradicionais

O Google não procura só respostas, ele procura respostas que ampliam a compreensão do tema.

Information Gain na prática

Em vez de explicar apenas como pedir revisão de juros, um conteúdo de alto ganho informacional incluiria:

- quais indicadores mostram que a revisão é necessária

- erros comuns de cálculo que o usuário deveria identificar

- documentos que o banco analisa

- critérios que o banco usa e que o usuário desconhece

- impacto real no fluxo de pagamento

- cenários em que a revisão é desfavorável

Esse tipo de âmago técnico é o que cria vantagem semântica.

Como alinhar estrutura com intenção classificada pelo sistema

O formato importa tanto quanto a precisão

Depois de entender a intenção e gerar o corpus, o sistema decide qual formato de resposta entregar.

Se a intenção for comparativa, trechos explicativos perdem força.

Se a intenção for instrucional, trechos analíticos são ignorados.

Se a intenção for exploratória, summaries curtos perdem profundidade.

Por isso, cada página precisa conter múltiplos modos de intenção.

É isso que te torna elegível independentemente do tipo de resposta escolhida.

Exemplo prático

Em uma única página, você inclui:

- parágrafos explicativos

- listas comparativas

- blocos analíticos

- definições independentes

- orientações passo a passo

- estruturas decisórias

Isso cria compatibilidade transversal e aumenta a chance de reutilização.

Como os modelos downstream transformam seu conteúdo em resposta

A patente deixa explícito que o AI Mode depende de uma cadeia de modelos especializados para produzir a resposta final.

Cada um desses modelos consome partes específicas do corpus, processa a informação de uma forma única e contribui para a construção da resposta entregue ao usuário.

Se você entende como esses modelos operam, entende exatamente como deve escrever.

Como o sistema decide o que cada modelo especializado vai consumir

Depois que o Google classifica a intenção dominante e organiza o corpus, ele precisa escolher qual conjunto de modelos downstream será ativado.

Esses modelos não fazem a mesma coisa.

Cada um tem uma função clara:

- extração estrutural

- síntese narrativa

- comparação

- decisão assistida

- sumarização seletiva

- transformação de formato

- normalização de unidades

O ponto crítico é este: cada modelo tem um tipo de trecho favorito.

Alguns consomem listas.

Outros consomem parágrafos densos.

Outros só funcionam com tabelas.

Outros buscam definições curtas.

Essa preferência determina o que entra no output final.

Como produzir trechos que atraem cada tipo de modelo

Se você quer ser selecionado, precisa criar múltiplos pontos de entrada para os modelos e isso exige organização semântica intencional.

A seguir, os tipos de trechos que cada modelo tende a priorizar com base nas funções descritas indiretamente pela patente.

Trechos que facilitam extração

Modelos de extração precisam de blocos que tenham:

- uma entidade central clara

- atributos explícitos

- separação conceitual

- ausência de ambiguidade

Um parágrafo que apresenta uma entidade com definição direta e característica mensurável é altamente reutilizável.

Trechos que facilitam síntese narrativa

Modelos de síntese preferem:

- encadeamento lógico

- progressão natural

- relação entre causa e efeito

- exemplos que representem situações típicas

Esses modelos precisam de material que ajude a construir narrativa sem ruído.

Trechos que facilitam comparação

Modelos comparativos trabalham com:

- diferenças funcionais

- critérios objetivos

- parâmetros que mudam de acordo com contexto

- contrastes explícitos

Se sua página não traz contrastes claros, você se torna invisível nesse modo de intenção.

Trechos que facilitam instrução

Modelos instrucionais precisam de:

- passos curtos

- progressão operacional

- ações verificáveis

- finalidade explícita

Não é sobre fazer listas longas.

É sobre criar blocos operacionais que o sistema reconheça como guia.

Como escrever de forma que o modelo consiga montar sínteses multi-autor

O AI Mode não se limita a extrair de uma única fonte.

Ele monta respostas utilizando trechos de múltiplas páginas.

A construção depende de três critérios invisíveis para o usuário comum:

- compatibilidade semântica

- consistência terminológica

- coesão entre granularidades diferentes

O que isso significa na prática

Se o seu conteúdo usa termos inconsistentes, o modelo descarta.

Se você apresenta ideias sem conexão, ele pula.

Se você mistura níveis de profundidade sem clareza, seu trecho perde utilidade.

Entenda na prática

Um conteúdo que define drenagem superficial como método para escoar água acumulada em áreas planas, explica como essa técnica reduz pressão sobre fundações e apresenta situações em que ela é insuficiente oferece três camadas que se conectam: definição, função e limitação.

Essas três camadas ajudam o modelo a encaixar o trecho em contextos diferentes.

Como aumentar a densidade semântica sem gerar paredes de texto

A densidade semântica é o nível de significados úteis por centímetro de texto.

Quando alta, facilita a seleção.

Quando baixa, desaparece.

Porém densidade não é o mesmo que textos longos.

A densidade ideal tem:

- uma entidade

- uma ação

- uma implicação

- um contexto

- ausência de ruído

Ela entrega algo completo em poucas linhas.

Estratégia prática

Pegue cada parágrafo do seu conteúdo e pergunte:

O que este bloco adiciona que não existe no bloco anterior

Se a resposta for nada, reescreva.

Como alinhar o conteúdo ao padrão de varredura do sistema

O AI Mode não varre páginas como um ser humano.

Ele opera em camadas paralelas:

- varredura de entidades

- varredura de relações

- varredura de propósito

- varredura de formato

Se uma página não facilita essas varreduras, ela perde eficiência.

Para otimizar isso, inclua:

- entidades explícitas

- relações explícitas

- finalidades explícitas

- formatos variados

Essa variedade torna seu conteúdo compatível com múltiplas intenções e múltiplos modelos downstream.

Como o sistema decide que um trecho vale a pena citar

A citação no AI Mode não é prêmio.

É consequência técnica.

O sistema procura trechos com:

- autoridade terminológica

- consistência com o corpus

- independência temática

- clareza contextual

- densidade de significado

Trechos que parecem neutros demais desaparecem.

Trechos opinativos sem bases estruturais também desaparecem.

O sistema busca equilíbrio: clareza, profundidade e neutralidade estruturada.

Agora você sabe o que ninguém explica:

O AI Mode não depende apenas do conteúdo certo.

Depende do conteúdo certo no formato certo para o modelo certo.

Como preparar páginas inteiras para sobreviver ao fan out do Google

Se até aqui você entendeu como o AI Mode interpreta intenções, gera queries sintéticas e seleciona trechos através de modelos especializados, agora entramos no ponto que vai definir a vitória no novo ambiente de busca: como estruturar páginas para serem descobertas, selecionadas e citadas dentro do fan out.

Diferente de um artigo tradicional, o AI Mode não lê sua página de cima para baixo.

Ele navega por ilhas semânticas, detecta entidades conectáveis, identifica padrões estruturais e avalia compatibilidade contextual com dezenas de queries derivadas.

Se sua página não facilitar esse processo, ela desaparece da disputa.

Por que a página é tratada como um ecossistema e não como um texto linear

Em mecanismos clássicos, o texto é entendido dentro de um contexto relativamente linear: título, cabeçalho, corpo, seção, conclusão.

No AI Mode, isso morre.

O modelo fragmenta a página em blocos independentes:

- blocos de definição

- blocos de função

- blocos de relação

- blocos de instrução

- blocos comparativo

- blocos condicionais

- blocos interpretativos

- blocos de exceção

Cada bloco é avaliado isoladamente e depois reconectado ao “constellation intent” gerado pelo fan out.

Páginas com blocos pouco diferenciados perdem força porque se tornam semanticamente homogêneas demais.

Quanto mais diversidade estrutural, maior o potencial de aproveitamento.

Como construir uma página que se auto-explica sem depender do restante da página

O AI Mode premia trechos capazes de existir sozinhos.

Isso significa que cada seção precisa funcionar como uma resposta completa, com:

- entidade principal

- contexto

- propósito

- implicação

- definições necessárias para eliminar ambiguidades

Essa característica torna o bloco elegível para síntese, mesmo se o restante da página não for considerado.

Como isso se aplica ao leitor humano

O leitor encontra clareza imediata e sente que a página está estruturada para ser absorvida rapidamente.

O algoritmo encontra consistência semântica.

Os dois ganham.

Como organizar uma página para criar acessos múltiplos para o modelo

O fan out cria dezenas de queries sintéticas.

Sua página precisa oferecer caminhos para todas elas.

Isso exige:

- múltiplas entradas semânticas

- repetição de entidades com funções diferentes

- blocos de intenção variada

- formatos de informação distintos

- clareza lexical com riqueza relacional

A seguir estão estruturas que funcionam extremamente bem no AI Mode.

Estrutura que prioriza definição

Títulos curtos, definição direta, sem floreio.

Blocos pequenos que explicam o conceito em 3 a 5 linhas.

Esse formato atrai modelos de extração, classificação e síntese inicial.

Estrutura que prioriza função

Mostra o que a entidade faz, como faz e para que serve.

É a partir desse formato que o sistema entende diferenças práticas entre temas parecidos.

Estrutura que prioriza condições

Aqui você orienta o modelo sobre quando algo vale ou não vale.

Isso ativa modelos instrucionais e modelos de decisão contextual.

Estrutura que prioriza relações

O AI Mode opera fortemente por relações.

Blocos que mostram relação entre entidades ajudam o sistema a decidir:

- qual é a entidade dominante

- qual é a entidade auxiliar

- qual é a implicação para o usuário

Exemplo de relação sem citar casos, apenas estruturas:

Uma explicação que relaciona um conceito a outro através de hierarquia, causalidade, funcionalidade complementar ou antagonismo aumenta o potencial de citação.

Estrutura que prioriza comparação

Comparações facilitam sínteses com foco em decisão.

Mesmo que a intenção seja informacional, comparações alimentam modelos downstream que precisam gerar respostas diferenciadoras.

Estrutura que prioriza processos

Sempre que você cria um processo com começo, meio e fim, você cria um bloco perfeito para síntese operacional.

Como impedir que sua página seja lida como conteúdo redundante

Redundância é um dos maiores motivos de exclusão.

Após o fan out, dezenas de páginas parecem dizer exatamente o mesmo.

Seu diferencial precisa estar em:

- explicações que não aparecem em outras páginas

- relações que ninguém mapeou

- implicações interpretativas

- perspectivas incomuns porém precisas

- granularidade maior

Seja diferente para ter o verdadeiro information gain.

Information Gain real

Aqui é onde a maior parte do conteúdo falha.

Information gain não é escrever mais.

É escrever algo que outros não escreveram e que o modelo consegue incorporar.

Você precisa entrar em mais profundidade em:

- mecanismos

- processos ocultos

- interações

- consequências

- limitações

- contexto operacional

- definições adjacentes

- causas indiretas

Blocos assim aumentam a chance de sua página ser escolhida mesmo quando competindo contra domínios maiores.

Como organizar visualmente para maximizar chunkability

Chunkability não é sobre cortar parágrafos, mas sobre criar unidades de pensamento autônomas.

Isso exige:

- parágrafos curtos

- títulos objetivos

- blocos independentes

- sequência lógica

- tabelas bem estruturadas

- listas com finalidade clara

- transições naturais

Cada bloco deve gerar uma síntese possível.

Como testei isso pessoalmente em dezenas de projetos

Aqui entra uma parte crítica da escrita: aplicação prática.

Exemplo prático de estrutura eficaz

Imagine uma página que explica um conceito técnico complexo.

Se ela começa com uma definição curta, segue com uma função, avança para condições específicas e depois demonstra relações com outros elementos, o modelo consegue:

- extrair a definição

- usar a função para explicar uma dúvida

- usar a condição para responder uma pergunta personalizada

- usar a relação para montar síntese multi-autor

Uma única página passa a cobrir múltiplas intenções.

Como combinar tudo em uma hierarquia que respeita a trajetória do leitor e do algoritmo

Um conteúdo perfeito para AI Mode segue três camadas simultâneas:

Camada humana

- legibilidade

- clareza

- organização intuitiva

- sensação de fluxo natural

Camada sintática

- segmentação

- títulos curtos

- delimitação de blocos

- consistência lexical

Camada semântica

- entidades fortes

- relações explícitas

- granularidade

- valor informacional

- compatibilidade com múltiplas intenções

Quando as três camadas se alinham, o conteúdo se torna um hub semântico compatível com fan out, favorecido por modelos downstream e compreensível para o leitor.

O blueprint definitivo de páginas otimizadas para AI Mode

O objetivo desta parte é simples: te entregar uma arquitetura que você consegue replicar em qualquer página, blog, serviço, guia, comparativo ou explicação técnica, e que posiciona você para disputar síntese no nível mais alto dentro do Google AI Mode.

Este blueprint resolve três desafios simultâneos:

- como ser compreendido pelo leitor

- como ser compreendido pelo modelo

- como ser útil dentro do fan out

Cada seção abaixo foi construída como uma unidade autônoma que pode ser citada pelo modelo sem depender do restante. Isso é essencial para competir no ambiente descrito na patente.

Estrutura base da página

A página completa deve conter:

-

bloco de definição

-

bloco de função

-

bloco de contexto

-

bloco de condições

-

bloco de relações

-

bloco de granularidade

-

bloco de exceções

-

bloco comparativo

-

bloco de processo

-

bloco interpretativo

-

bloco de aplicação prática

-

bloco de síntese final

Cada bloco precisa existir como resposta independente.

Agora vamos criar cada um deles com profundidade.

1. bloco de definição

Título curto, direto, simples.

A função deste bloco é garantir que qualquer modelo downstream consiga identificar o “core meaning” da entidade principal.

Como escrever o bloco:

- defina a entidade sem floreios

- explique o propósito da entidade

- elimine ambiguidades que confundiriam o modelo

Exemplo de construção:

Uma definição clara transforma a entidade em ponto fixo no grafo semântico do sistema. Esse tipo de definição reduz colisões com outros significados e aumenta o potencial de citação.

2. bloco de função

Aqui você entrega ao modelo o que a entidade faz.

Este é um dos blocos mais importantes para síntese natural.

Como escrever o bloco:

- descreva a função principal

- descreva funções secundárias

- indique consequências práticas

Quando o sistema precisa responder dúvidas específicas, ele recorre a blocos de função para determinar como explicar o impacto da entidade.

3. bloco de contexto

Se você não contextualiza, o modelo não sabe quando a informação se aplica.

Este bloco cria a “zona de aplicabilidade semântica”.

Como escrever o bloco:

- explique quando a entidade importa

- descreva o cenário típico

- indique fatores que moldam a interpretação

Esse tipo de conteúdo ajuda o modelo a escolher seu texto como fonte contextual.

4. bloco de condições

Este bloco define quando algo vale e quando não vale.

É onde os modelos de decisão entram em ação.

Como escrever o bloco:

- condições de ativação

- condições de limitação

- condições de exceção

Blocos de condição são muito utilizados no AI Mode para perguntas personalizadas.

5. bloco de relações

O Google trabalha com relações, não com palavras.

Este bloco ajuda o sistema a conectar conceitos.

Como escrever o bloco:

- relacione a entidade com uma superior

- relacione com uma subordinada

- relacione com entidades complementares

Isso aumenta o “reach semântico” da sua página no fan out.

6. bloco de granularidade

Um dos maiores fatores de information gain.

Granularidade = profundidade real.

Como escrever o bloco:

- explique nuances

- traga mecanismos

- detalhe subcomponentes

- traga fatores de variação

Esse bloco te diferencia de conteúdos genéricos.

7. bloco de exceções

Modelos adoram exceções.

Elas são úteis para:

- desambiguação

- refinamento

- respostas condicionais

Esse bloco aumenta a chance de citação em respostas que começam com “depende”.

8. bloco comparativo

Modelos downstream usam comparações para sintetizar escolhas e contrastes.

Seu conteúdo precisa fornecer comparações claras.

Como escrever o bloco:

- compare entidades próximas

- mostre diferenças funcionais

- mostre diferenças de uso

- Comparações são poderosas em decisões.

9. bloco de processo

Um dos blocos mais úteis para síntese.

Modelos citam processos porque são fáceis de reorganizar.

Como escrever o bloco:

- etapas curtas

- linguagem simples

- início, meio e fim

Cada etapa vira um chunk.

10. bloco interpretativo

Aqui você oferece interpretação, o que nenhum conteúdo superficial faz.

Como escrever o bloco:

- o que isso significa para o usuário

- por que importa

- que impacto tem no contexto real

Isso aumenta o valor percebido e a autoridade.

11. bloco de aplicação prática

Tudo que você escreveu até aqui agora precisa se tornar útil.

Como escrever o bloco:

- cenários concretos

- problemas comuns

- como aplicar o conhecimento no mundo real

Esse bloco reduz atrito e aproxima do leitor.

12. bloco de síntese final

Este bloco encerra explicando o essencial para humanos e modelos.

Como escrever o bloco:

- resuma a entidade

- reforce o contexto

- mostre o valor do conhecimento

- indique o próximo passo

Como tudo se encaixa na lógica do AI Mode

Este blueprint atende exatamente às etapas do sistema descritas na patente:

- otimiza a leitura fragmentada

- maximiza chunkability

- amplia presença no fan out

- melhora a seleção nos modelos downstream

- facilita síntese multi-autor

- oferece information gain superior

- aumenta probabilidade de citação

Você agora tem a estrutura exata do que o Google espera de um conteúdo moderno.

O AI Mode não reinventa apenas o Google. Ele reinventa o que significa ser encontrado

No final de tudo, quando você olha para a patente, para a FIG. 9, para o pipeline de raciocínio e para a forma como o Google reorganiza intenção, fica nítido que estamos vivendo o maior deslocamento conceitual da história da busca.

A busca não é mais o ato de digitar uma pergunta.

É o processo de interpretar necessidade.

É o trabalho de decodificar comportamento.

É a capacidade de sintetizar conhecimento.

O Google não está mais perguntando qual site merece ficar no primeiro lugar.

Ele está perguntando:

Quem entrega o significado que o usuário precisa naquele instante.

Essa é a nova concorrência.

Você não disputa posição.

Você disputa participação cognitiva.

Você disputa espaço dentro do corpus que alimenta o raciocínio das IAs.

Você disputa a chance de ser a fonte citada, a referência útil, a entidade confiável.

Nada disso é sobre SEO como conhecíamos.

É sobre engenharia editorial.

É sobre linguística aplicada.

É sobre arquitetura semântica.

É sobre previsibilidade cognitiva.

É sobre compreender intenção antes do próprio usuário.

Se você cria conteúdo apenas para palavras-chave, você está otimizando para um mundo que não existe mais.

Se você escreve páginas longas sem granularidade, você está se tornando invisível para o pipeline de síntese.

Se você não entende como embeddings e fan-out funcionam, você está fora da conversa antes dela começar.

A verdade é uma só.

Ou você cria conteúdo que ajuda o modelo a pensar, ou o modelo não precisa de você.

E quem cria para o modelo automaticamente se torna melhor para o leitor humano.

Porque clareza, precisão, densidade semântica, profundidade e utilidade são princípios universais.

O AI Mode não eliminou o SEO.

Ele iluminou quem realmente sabe o que está fazendo.

Este é o ponto em que o profissional comum se perde.

E é o ponto em que um Consultor SEO de verdade cresce.

O que fazer a partir de agora

Se você leu até aqui, já entende que não existe mais espaço para conteúdo genérico, raso ou duplicado.

O que você precisa agora é:

Dominar a semântica

Dominar a intenção

Dominar a estrutura

Dominar a arquitetura

Dominar a previsibilidade para IA

Dominar a granularidade editorial

O futuro não pertence a quem cria muito conteúdo.

Pertence a quem cria conteúdo que o sistema consegue usar.

E isso é o que eu faço todos os dias.

No seu site, no seu projeto, na sua marca.

Com estratégia, engenharia e precisão.

Se você quer que seu site continue existindo em um mundo dominado por IA, agora é a hora de agir

Se precisar transformar o seu site em uma fonte permanente de informação no ecossistema do Google, posso te ajudar a estruturar:

- conteúdo preparado para fan-out

- páginas elegíveis ao corpus sintético

- arquitetura montada por intenção

- entidades distribuídas corretamente

- padrões para passage ranking

- densidade para embeddings

- ontologia completa do nicho

- mapeamento semântico profundo

- conteúdo sustentável para AI Mode

- estrutura editorial capaz de gerar citações

Você não precisa adivinhar o futuro.

Você só precisa se preparar para ele.

E se quiser começar, basta me chamar.

Eu te mostro exatamente o que fazer, página por página, camada por camada, até o seu site se tornar a referência que o sistema procura quando precisa entregar significado.

Pronto para isso?